위상 데이터 분석 기반 선박 블록의 대용량 3차원 포인트 클라우드 경량화 및 품질 분석

This is an Open-Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License(http://creativecommons.org/licenses/by-nc/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited.

Abstract

The adoption of various Industry 4.0 technologies in the shipbuilding sector has recently accelerated, with particular attention being given to techniques utilizing three-dimensional(3D) point cloud data acquired from LiDAR scanners. However, the raw 3D point cloud data presents significant challenges in storage, processing, and analysis due to its high-dimensional and large-scale nature. This necessitates a lightweighting process following initial post-processing. Accordingly, this study proposes a lightweighting technique based on Topological Data Analysis(TDA) for the efficient handling of 3D point clouds. TDA is a methodology that utilizes persistent homology, an adaptation of the core topological concept of homology tailored for data analysis. Based on TDA, feature points were extracted by considering the size and complexity of the point cloud, guided by the lifetime of homological features in the persistence diagram, which plots their birth and death. Specifically, features with longer lifetimes are considered topologically significant; by selectively extracting these persistent points, the overall size of the dataset is reduced. For field validation, the TDA-based lightweighting method was applied to actual measurement data from ship blocks. The results demonstrate that the proposed technique excels at preserving geometric features while significantly reducing data volume. Consequently, the lightweighting technique developed in this research is anticipated to enhance the utility of datasets for deep learning applications in the future.

Keywords:

3D point cloud, Feature point, Topological Data Analysis(TDA), Persistent homology키워드:

3차원 포인트 클라우드, 특징점, 위상 데이터 분석, 지속적 호몰로지1. 서 론

최근 조선업뿐만 아니라 다양한 산업 현장에서 4차 산업혁명 기술의 적용과 함께 스마트 기술의 중요성이 증가하고 있으며 스마트 제조 및 관리 기술이 도입됨에 따라 보다 정밀하고 효율적인 생산 및 프로세스 관리가 요구되고 있다. 특히 3차원 스캐닝 기술을 통해 계측된 3차원 포인트 클라우드(3D point cloud)를 활용한 스마트 생산관리 기술이 주목 받고 있다. 3차원 스캐닝(3D scanning) 기술은 3차원 스캐너를 이용하여 레이저나 백색광을 대상물에 투사하여 대상물의 형상 정보를 취득, 디지털 정보로 전환하는 모든 과정을 통칭하는 용어이다. 3차원 포인트 클라우드는 3D 레이저 스캐너, LiDAR(Light Detection and Ranging) 및 구조광(structured light) 기술 등을 통해 물체의 외형을 고밀도의 점들(points)로 수집한 데이터를 의미한다. 각 점들은 물체의 표면 형태와 구조를 상세히 묘사함으로써 선박 블록과 같이 복잡한 대형 구조물의 정확한 계측과 품질 관리를 가능하게 하였으며 이러한 장점으로 다양한 산업은 물론 조선업에서도 중요한 자원으로 그 응용 범위가 점점 확대되고 있다.

조선업 분야의 3차원 포인트 클라우드는 품질관리 및 조립 공정에서 점차 중요한 역할을 담당하고 있으며 관련 연구들이 활발히 이루어지고 있다. 전통적인 수동 검사 방식은 시간 소모가 많고 검사 범위가 제한적이며 작업자의 숙련도에 의존하는 경향이 있는 반면 3차원 스캐닝 기술은 비접촉 방식으로 방대한 양의 3차원 형상 정보를 신속하게 취득하여 건조 중인 선박 블록이나 구조물의 치수 정확도, 변형 여부 등을 설계 데이터와 비교하여 정량적으로 평가할 수 있다 (Jung et al., 2025). 이처럼 초기 연구들은 주로 3D 스캔 데이터와 CAD 데이터 간의 비교를 통해 치수 정확도를 검증하는데 초점을 맞추었다. 레이저 스캔 데이터로부터 곡면 외판 부재를 추출하고 CAD 데이터와 정합하여 정확도를 평가하는 시스템이 개발된 사례가 있으며 (Sun et al., 2014), 복합소재 소형선박 건조의 주요 단계에서 각 단계별 형상 변화와 품질 편차를 정량적으로 추적하고 관리하는 사례가 제시되었다 (Lee and Park, 2023).

최근 연구는 단순한 치수 비교를 넘어 3차원 포인트 클라우드의 데이터 분석을 통해 보다 구체적인 품질 문제를 다루고 예측하는 방향으로 발전하고 있다. Song et al. (2022)은 Octree 구조로 공간을 분할하고 각 구역 내에서 RANSAC 알고리즘으로 평면을 추정하여 평면에서 벗어나는 이상치(outlier)를 통해 선체 구조물의 함몰이나 돌출과 같은 변형을 효과적으로 탐지하는 방법을 제안하였으며, Jang et al. (2018)은 선박 블록 간의 정합 오차를 분석하여 단순히 정확도를 평가하는 것을 넘어 용접 재작업에 소요되는 시수를 예측하였다. 이를 위해 k-means 클러스터링으로 용접 관련 점들을 분리하고 Concave hull 알고리즘으로 접합부 윤곽선을 추출하여 재작업 시간을 최소화하는 방안을 모색하였다. 또한, 3차원 포인트 클라우드의 의미 있는 정보를 추출하고 분석하기 위한 기법들이 연구되고 있으며 형상이나 구조를 나타내는 특징 추출은 객체 인식, 정합, 모델링 등 다양한 응용의 핵심 분야이다. Guo et al. (2024)은 3차원 선박 데이터의 기하학적 선형 특징을 자동으로 인식하고 식별하기 위하여 딥러닝 기반 접근법을 활용하였으며, Lee et al. (2021)은 딥러닝 기반 LNGC 화물창 내 비계 시스템의 특징을 학습하고 객체를 탐지하였다. 또한 Wang et al. (2020)은 선박 블록 건조 오차 분석을 위해 신속한 정합 방법을 연구의 핵심 목표로 삼았다.

이처럼 조선업 분야에서 다루는 3차원 포인트 클라우드는 선박 블록과 같이 복잡한 형상을 상세하게 묘사할 수 있다는 명백한 장점을 가진다. 그러나 동시에 상당한 기술적 과제를 야기하며 원본 포인트 클라우드 데이터는 본질적으로 방대한 규모를 갖는 특징으로 인해 수백만, 수천만 개에 달하는 점으로 구성되어 저장, 전송, 처리 및 분석의 모든 단계에서 막대한 컴퓨팅 자원을 요구한다. 이러한 기술적 문제는 단순히 전산 자원의 소모에 그치지 않고 스마트 조선소의 운영 효율성을 저해하는 문제로 이어진다. 3차원 스캐닝을 통한 데이터 취득 시간이 단축되더라도 후속 데이터 처리 과정에서 지연이 발생한다면 신속한 의사결정이 불가능해질 것이다. 이는 스마트 기술 도입의 근본적인 목적인 생산성 향상을 저해하는 역설적인 상황을 초래한다.

따라서 3차원 포인트 클라우드 데이터의 경량화는 선택적인 후처리 과정이 아닌 대용량 3차원 데이터를 조선업 현장에서 실용적으로 활용하기 위한 필수 과정이라 할 수 있다. 이 과정의 핵심은 단순히 점의 개수를 줄이는 것을 넘어 원본 데이터의 중요한 구조적, 형상적 특징을 유지하는데 있으며 데이터의 양을 줄이면서도 품질 관리와 분석에 필요한 핵심 정보를 보존하는데 있다. 본 연구에서는 위상 데이터 분석(Topological Data Analysis, TDA) 기반의 경량화 기법을 제안하였으며 경량화 데이터의 다각적인 품질 분석을 통하여 기존의 경량화 기법과 성능을 비교하고 제안하는 기법의 성능을 검증하고자 한다.

2. 3차원 포인트 클라우드 경량화 기법

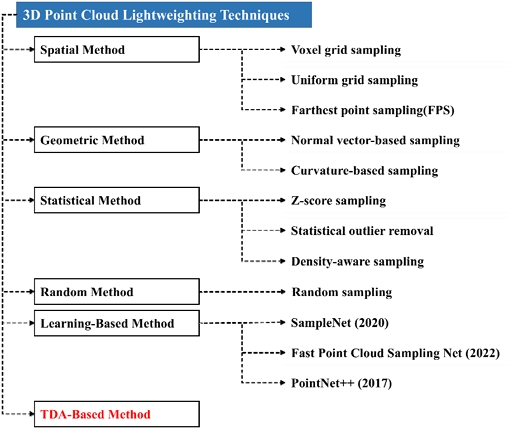

기존 3차원 포인트 클라우드의 경량화를 위한 기법은 점의 중요도를 판단하는 원리에 따라 공간적 기법, 기하학적 기법, 통계적 기법, 무작위 기법, 학습 기반 기법으로 구분할 수 있으며 Fig. 1에 나타내었다.

공간적 기법은 3차원 공간에서 일정한 격자(grid) 또는 간격으로 분할한 후 그 공간에서 대표적인 점들을 선택하는 방식이다. 대표적으로 Voxel grid sampling, Uniform grid sampling 등이 있으며 이 기법은 직관적이고 구현이 간단한 장점이 있으며 복잡도 제어, 균일한 분포 측면에서 안정적이다. Voxel grid sampling은 각 셀마다 하나의 점만 남기기 때문에 밀도가 높은 영역은 더 많이 제거되고 희소한 영역은 유지되는 효과가 있어 공간 전체를 균일하게 표현하는데 강점을 가진다. 하지만 이 방식은 기하학적 중요성이나 특징을 고려하지 않기 때문에 경계선이나 모서리 등의 정보가 손실될 수 있다.

반면 기하학적 기법은 3차원 포인트 클라우드의 법선 벡터(normal vector), 곡률(curvature), 경계(edge) 등 표면의 구조적 특징을 활용하여 의미 있는 점을 우선적으로 유지하는 방식이다. 대표적으로 Normal vector-based sampling, Curvature-based sampling 등이 있다. 이 기법은 형상의 의미 있는 부분을 보존하는데 강력한 장점이 있으며 법선 벡터는 대부분 경계선이나 모서리, 굴곡이 큰 부분에서 변화가 크므로 이러한 영역을 보존함으로써 객체의 기하학적 특성을 효과적으로 유지할 수 있다. 하지만 법선 벡터나 곡률 계산을 전제하므로 상대적으로 비용이 높고 노이즈가 많은 데이터에서는 오히려 오류를 유발할 수 있다.

통계적 기법은 점 주변의 이웃 밀도, 거리 분포, 확률 등을 기반으로 점의 중요도를 통계적으로 평가하여 간소화하는 방식이다. 대표적으로 Z-score sampling, Statistical outlier removal, Density-aware sampling 등이 있으며 장점으로는 데이터의 분포를 이해하고 밀도에 따라 점을 조절할 수 있다는 것이며 노이즈가 많거나 밀도 편차가 큰 데이터에 유용하다. 즉 점들이 조밀한 부분에서는 점을 덜 선택하고 희소한 부분에서는 더 유지함으로 점 분포의 편향을 줄일 수 있다. 하지만 계산 비용이 높아 대규모 데이터에는 연산 시간이 오래 걸려 적합하지 않을 수 있다.

다음으로 무작위 기법은 점들을 특정 확률이나 규칙 없이 무작위로 선택하는 방식으로 Random sampling이 가장 대표적인 기법이다. 이는 무엇보다 빠르게 계산이 가능하고 간단하여 초기 테스트, 대용량 시각화 등 빠른 데이터 축소를 위해 자주 사용되나 형상 보존, 공간 균일성, 기하학적 정보를 전혀 고려하지 않기 때문에 품질이 보장되지 않는다. 특히 중요한 경계선이나 굴곡이 큰 형상이 누락 될 수 있으며 결과의 일관성이 떨어지고 재현성이 낮다는 단점이 있다.

마지막으로 학습 기반 기법은 최근 딥러닝을 기반으로 중요한 점들을 선택해 학습하는 연구도 활발히 진행되고 있다. 대표적으로 SampleNet, Fast Point Cloud Sampling Net, PointNet++ 등이 있으며 이는 데이터 기반으로 어떤 점들이 중요한지 딥러닝 모델이 직접 학습하기 때문에 최적화된 샘플링이 가능하여 분할, 분류, 재구성 등에 높은 성능을 보이고 있다. 하지만 딥러닝 모델에 학습시키기 위한 레이블링(labeling), 학습 및 검증 시간, 연산 자원 등을 요구하여 범용성이 낮은 한계점을 가지고 있어 본 연구에서는 학습 기반 기법을 제외한 경량화 기법에 대한 품질 분석을 수행하였다.

선박 블록은 고차원 비정형 형상을 포함하고 있어 기존의 공간 기반 또는 기하학 기반의 경량화 기법으로는 중요한 구조적 특징을 온전히 보존하기 어려운 문제점이 있다. 이처럼 복잡한 산업 구조물의 경우 단순한 거리, 밀도, 곡률 기반의 접근법은 데이터의 핵심 위상 정보를 간과할 가능성이 크다. 이러한 한계를 극복하기 위하여 본 연구에서는 위상 데이터 분석(TDA) 기반의 경량화 기법을 도입하고자 한다.

TDA는 데이터에 내재된 위상학적 구조를 측정하기 위해 호몰로지(homology)라는 정량적 도구를 사용하며 이는 연결성분(connected components), 루프(loops), 공허(voids)와 같은 위상학적 특징들의 개수를 각 차원별로 측정하는 방법이다. 이렇게 측정된 차원별 호몰로지들의 지속성(persistence)을 분석함으로써 데이터 내의 고차원적인 구조적 중요도를 평가할 수 있다. 특히 TDA에서 사용되는 지속성 도표(persistence diagram)는 각 위상학적 구조의 생성(birth)과 소멸(death) 시점을 시각화하여 생존 시간(lifetime)이 긴 호몰로지를 구분할 수 있게 한다.

본 연구에서는 이를 통해 데이터의 핵심 구조를 보존하면서도 생존 시간이 짧은 호몰로지의 점들을 제거하는 방식으로 경량화를 수행하였다. 본 연구의 목표는 선박 블록과 같은 조선업 환경의 대용량 3차원 포인트 클라우드를 대상으로 TDA 기반 경량화 기법을 적용하여 데이터의 품질을 유지하면서도 불필요한 요소를 효과적으로 제거하고 이를 통해 대용량 데이터를 경량화하고자 한다. 이는 기존의 경량화 기법들이 간과했던 고차원 위상학적 구조의 특징을 보존하면서 저장 공간을 절약하고 처리 효율성을 동시에 향상시키고자 한다.

3. 위상 데이터 분석 기반 경량화 기법

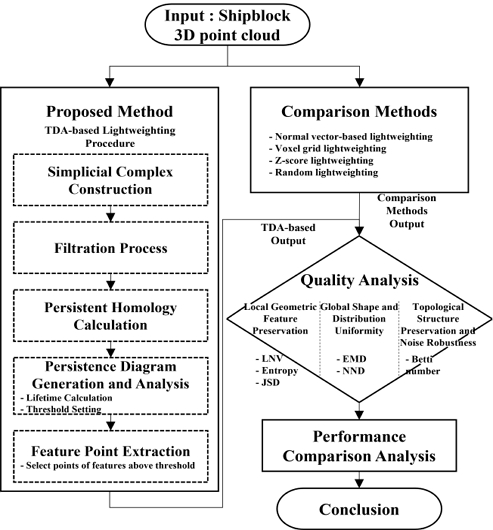

본 연구에서는 TDA 기반 경량화 기법의 우수성을 검증하기 위해 Fig. 2와 같이 연구 절차에 따라 진행하였다. 분석 대상인 대용량 선박 블록 3차원 포인트 클라우드에 본 연구에서 제안하는 TDA 기반 경량화 기법과 기존의 대표적인 경량화 기법을 각각 적용하였으며 이후 각 기법으로 경량화된 결과 데이터에 대해 다각적인 품질 분석을 수행하고 그 성능을 비교 분석하였다.

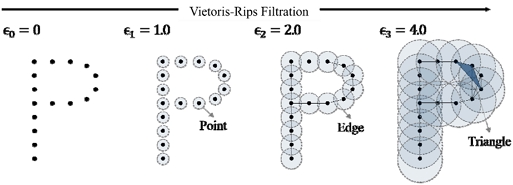

TDA 기반 특징점 경량화는 크게 단체 복합체 구성, 여과 과정 적용, 호몰로지 계산, 지속성 도표 생성 및 분석과 특징점(feature point) 추출 단계로 구분할 수 있다. 먼저 Fig. 3은 3차원 포인트 클라우드에 Vietoris-Rips 알고리즘을 적용하여 단체 복합체(simplicial complex)를 구성하는 과정을 나타낸다 (Bauer, 2021).

Vietoris-Rips 알고리즘은 점 사이의 거리 임계값(ϵ)을 점차 증가시키면서 가까운 점들을 연결하여 단체(simplex)를 형성해 나간다. 이러한 임계값 증가에 따른 단계적 구성 과정을 여과(filtration)라 하며 초기에는 모든 점(point, 0-simplex)이 개별적으로 분리되어 있지만 임계값이 커지면 일정 거리 이내의 점들이 선(edge, 1-simplex)으로 연결되고 임계값이 더 증가하면 세 점 이상의 점들이 삼각형 면(triangle, 2-simplex)을 이룬다. 이와 같이 임계값을 키워감에 따라 점-선-면으로 이루어진 단체 복합체가 점진적으로 확장되어 전체 점들의 형태를 포괄하게 된다.

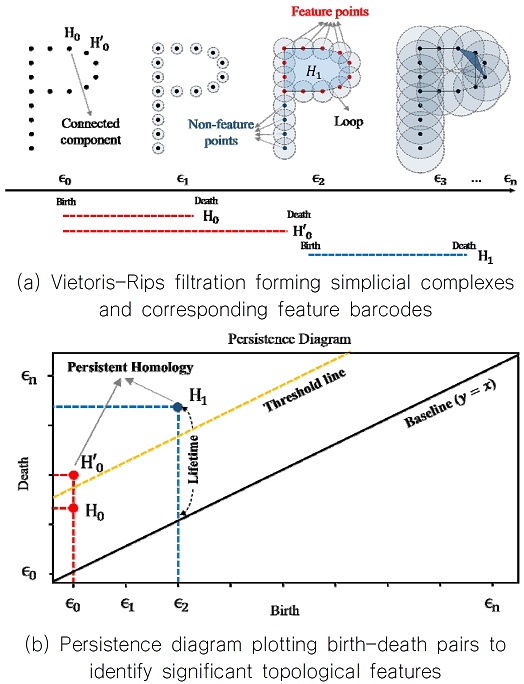

다음으로 Fig. 4는 여과 과정을 통해 추출된 단체 복합체로 이루어진 호몰로지의 생성과 그 생성 및 소멸의 시점을 가시화하여 나타낸 지속성 도표를 나타내었다. 호몰로지란 단체 복합체에 내재된 위상학적 구조로써 연결성분, 루프, 공허와 같은 특징을 의미하며 여과 매개변수(임계값)가 변함에 따라 호몰로지 구조들이 생성하거나 소멸하는데 이는 각 특징의 생성 시점과 소멸 시점으로 기록될 수 있다. 초기 단계에서는 개별 점들이 각자 하나의 연결성분인 0차 호몰로지(H0)로 존재하지만 임계값이 증가함에 따라 서로 연결되어 더 큰 연결성분으로 합쳐지면 기존의 작은 연결성분은 소멸한다. 예를 들어 일정 임계값에서 점들이 원형으로 연결되면 루프 구조의 1차 호몰로지(H1)가 생성되고 임계값이 더욱 커져 루프가 메워지는 순간 해당 H1은 소멸한다.

Fig. 4(a)와 같이 초기 상태(ϵ0)에서는 점 하나하나가 그 자체로 하나의 연결성분이 되며 0차 호몰로지의 개수와 점의 개수는 동일한 상태이다. 이후 임계값이 ϵn까지 증가됨에 따라 ϵ0에서 생성된 0차 호몰로지 H0와 의 경우 각각 H0는 ϵ1이후 소멸되고 는 ϵ2에서 소멸되었다고 가정하였을 때 의 생존 시간이 더 오래 지속되기 때문에 중요한 위상학적 구조를 가진 호몰로지라고 할 수 있다. 또한 ϵ2에서는 루프 구조의 1차 호몰로지 H1가 새로 생성되고 임계값이 계속 증가함에 따라 루프와 같은 위상학적 특징이 사라지면서 ϵ3이후 소멸되었다. 이처럼 각 호몰로지의 생성에서 소멸까지 유지되는 시간을 생존 시간(lifetime)이라 하며 상대적으로 긴 생존 시간을 가지는 호몰로지를 지속적 호몰로지(persistent homology)라 한다.

1차 호몰로지(H1)가 소멸된 이후에도 여과 과정은 임계값이 증가함에 따라 지속되며 더 높은 차원의 위상학적 구조가 나타날 수 있다. 예를 들어 삼각형 면들이 서로 모서리를 공유하며 연결되어 하나의 닫힌곡면을 형성하면 그 내부에 빈 공간이 만들어지게 되고 이를 2차 호몰로지(H2)라 한다. 마찬가지로 H2 구조 또한 임계값이 더욱 증가하여 그 내부 공간이 완전히 채워지는 순간 소멸하게 된다 (Kong and Fan, 2024).

다음으로 생성된 호몰로지를 구성하는 특징점을 추출하는 과정은 생존 시간 계산, 임계값 설정, 위상학적 구조와 특징점 매핑, 비특징점(non-feature point) 제거로 이루어지며 이 과정에서 Fig. 4(b)의 지속성 도표를 활용하였다. 생존 시간의 계산은 기준선(baseline)으로부터의 수직 거리로 계산되며 여기서 기준선은 생성 시점과 소멸 시점이 동일함을 의미하고 기준선 위의 호몰로지는 생성되자마자 소멸했음을 뜻한다. 다음으로 임계값 설정은 지속성이 높은 호몰로지와 낮은 호몰로지를 구분하기 위해 기준선에 임계값만큼 평행 이동한 임계선(threshold line)을 설정하였으며 목표하는 경량화율에 도달할 때까지 가장 긴 생존 시간을 갖는 호몰로지부터 순차적으로 선택하였다. 이러한 지속적 호몰로지를 계산하는 알고리즘은 각 호몰로지에 어떤 단체들이 관여했는지 어떤 점들이 해당 호몰로지를 구성했는지에 대한 정보를 기록하고 있으며 이를 활용해 위상학적 구조와 매핑되어 있는 특징점을 추출하였다. 마지막으로 비특징점 제거의 경우 마찬가지로 생존 시간이 임계값보다 짧은 호몰로지를 구성하는 모든 점들을 식별하여 제거함으로써 경량화를 수행하였다.

4. 경량화 데이터의 다각적 품질 평가

본 연구에서 제안하는 TDA 기반 경량화 기법의 성능을 기존 경량화 기법들과 객관적이고 종합적으로 비교 평가하기 위해서는 다각적인 품질 평가 방법이 필수적이라 판단하였다. 특히 선박 블록과 같이 복잡한 대규모 3차원 포인트 클라우드의 경량화 데이터 품질은 단일 지표만으로 온전히 평가하기 어렵기 때문에 본 장에서는 경량화 데이터의 품질을 체계적으로 평가하기 위한 다각적 평가 방법을 제안하였다. 이러한 평가 방법은 관련 연구에서 개별적으로 사용되었던 평가 지표들을 본 연구에 맞게 재구성하였으며 다음 세 가지 측면에 초점을 맞추어 평가하였다.

첫째로 지역적 기하 특징 보존성인 표면의 굴곡, 모서리, 경계선 등 지역적인 세부 형상이 경량화 후에도 얼마나 유지되는지를 평가하기 위한 항목으로 LNV(Local Normal Variation)와 FPFH(Fast Point Feature Histograms) 기반의 엔트로피, JSD(Jensen-Shannon Divergence) 지표를 사용하였다. 두 번째는 전역적 형상 및 분포 균일성으로 이는 객체의 전체적인 형태, 규모, 공간적 분포가 원본과 얼마나 유사하게 유지되는지와 경량화된 점들이 얼마나 효율적으로 분포되었는지를 평가하기 위한 항목으로 EMD(Earth Mover’s Distance)와 NND(Nearest Neighbor Distance) 지표를 활용하였다. 마지막으로 위상 구조 보존성 및 노이즈 강건성의 경우 위상학적 특징 보존성과 함께 실제 계측 환경에서 흔히 발생하는 노이즈에 대한 강건성을 평가하기 위하여 각각 Betti 수 지표를 사용하고 Gaussian noise를 추가하여 재평가하였다. 이러한 다각적 평가 방법은 특정 측면에 치우치지 않고 세 가지 측면에서 균형 잡힌 평가 결과를 제공하기 위함이다. 또한 평가의 공정성을 확보하기 위하여 모든 경량화 기법의 경량화율은 선박 블록 원본 데이터(800,703 points)의 약 10%로 동일하게 설정하였으며 노이즈 추가는 원본 데이터에 10% 노이즈를 추가 후 경량화를 수행하였다.

본 연구의 데이터 품질 평가를 위한 구현은 3차원 포인트 클라우드 처리 및 분석을 위해 널리 사용되는 검증된 오픈소스 라이브러리를 활용하였다. 3차원 포인트 클라우드의 입출력, 최근접 이웃 탐색, 법선 벡터 추정 등에 필요한 기본적인 기하학적 처리 전반에는 Open3D 라이브러리를 주로 사용하였으며 이는 LNV와 FPFH 계산의 기반이 된다. 다음으로 계산된 FPFH 히스토그램 분포의 엔트로피 및 JSD, NND 그리고 EMD의 계산은 SciPy와 NumPy의 계산 함수를 활용하였으며 Betti 수 계산을 위해서는 Ripser를 사용하여 평가 지표를 구현하였다.

4.1 지역적 기하 특징 보존성 평가

LNV은 원본 데이터와 경량화 데이터의 대응되는 점들의 법선 벡터 방향 간 각도차를 계산하여 표면의 기울기나 곡률과 같은 특징의 보존 상태를 평가하는 직관적인 지표이다. 선박 블록의 경우 광활한 평판, 완만하게 변하는 외판, 보강재의 모서리와 같이 법선 벡터가 급격하게 변하는 표면 특징이 공존하며 LNV는 이러한 선박 블록의 평탄도 변화나 굴곡의 보존 상태를 정량적으로 평가하는데 유용하다. 이를 식 (1), (2)에 나타내었으며 원본 데이터 각 점의 법선 벡터 ni와 경량화 데이터 각 점의 법선 벡터 를 계산한다. 법선 방향 차이 θi는 두 법선 벡터의 내적을 통해 두 벡터 사이의 각도를 구하였으며 법선이 반대 방향을 가리키는 것을 고려하여 절대값을 취하였다.

| (1) |

이처럼 각 점에 대한 법선 방향 차이를 계산한 후 전체 대응점에 대한 법선 방향 차이를 평균값으로 구하였다. 일반적으로 평탄한 면에 위치한 점들은 LNV가 작고 곡면이나 모서리 부근의 점들은 법선 변화가 크므로 LNV도 증가한다. 따라서 LNV를 통해 경량화 후에도 평탄부, 곡면부 등의 형상이 원본과 얼마나 일치하는지를 정량적으로 평가하였다 (Honti et al., 2022).

| (2) |

LNV가 개별 점의 표면 방향성이라는 단일 정보에 집중하는 반면 FPFH는 한 점을 중심으로 주변 점들 간의 기하학적 관계를 33차원의 히스토그램 형태로 표현한 대표적인 특징 기술자(descriptor)이다 (Rusu et al., 2009). 각 차원은 주변 점들의 거리나 법선 방향 분포 등 특정 기하학적 관계를 나타내며 해당 점 주변의 형상 패턴을 요약한다. 본 연구에서는 선박 블록의 원본 데이터와 경량화 데이터의 FPFH 히스토그램 정보량 보존 및 분포 유사도를 평가하기 위해 엔트로피와 JSD를 활용하였다.

먼저 엔트로피는 분포의 무질서도 또는 정보량을 측정하는 지표로 식 (3)과 같이 계산된다. pk는 사건 k가 발생할 확률이며 logpk는 확률이 작을수록 큰 음수로 나타낸다. 여기에 확률 pk를 곱하면 정보량을 그 사건이 실제 일어날 빈도에 맞게 가중 평균하는 효과가 있다. 이를 전체 가능한 사건 K에 대해 모두 더한 뒤 ‘-’부호로 다시 음수를 양수로 반전해 준다 (Hu et al., 2023).

| (3) |

FPFH 히스토그램의 엔트로피가 높을수록 분포가 균일하고 정보가 풍부함을 의미하며 낮을수록 특정 차원에 치우친 편중된 분포임을 나타낸다. 경량화 데이터의 엔트로피가 원본 데이터와 유사하다면 특징 분포의 다양성이 유지되었음을 의미하고 감소된 경우 특정 정보가 손실되었을 가능성을 시사한다.

다음 JSD는 두 확률분포 P와Q 간의 유사도를 측정하는 대표적인 지표로 P를 원본 데이터의 FPFH 히스토그램 분포, Q를 경량화 데이터의 분포로 두었을 때 식 (4)와 같이 계산된다. 여기서 D(∥)는 Kullback-Leibler(KL) 발산이며 M은 두 분포의 평균으로 구성한 중간 분포이다 (Achlioptas et al., 2018).

| (4) |

여기서,

JSD는 0에서 1사이의 값을 가지며 0에 가까울수록 분포가 유사함을 의미한다. 이는 두 FPFH 히스토그램 분포 간의 차이를 측정하면서도 극단적인 확률 값에 민감하지 않아 두 데이터의 특징 분포 비교에 적합하다. 특히 앞서 엔트로피와 함께 사용함으로써 정보량 보존 정도와 분포 형태 유사성을 모두 평가할 수 있다. 엔트로피만 평가하는 경우 경량화 데이터의 정보량 수준을 원본 데이터와 평균적으로 비교하므로 두 히스토그램의 분포가 다르지만 평균 엔트로피는 유사할 수 있는 한계가 있다. 반면에 JSD는 FPFH 히스토그램 분포의 전체적인 패턴을 비교하기 때문에 원본 데이터의 패턴을 얼마나 유지하는지 직접 비교하므로 상호보완적으로 평가할 수 있다.

4.2 전역적 형상 및 분포 균일성 평가

EMD는 두 분포 간의 차이를 측정하는 지표로써 한 분포를 다른 분포로 변환하는데 드는 비용 또는 일(earth moving)의 양으로 정의된다. 선박 블록과 같은 대규모 구조물은 그 크기가 크고 내부가 복잡하여 경량화 과정에서 공간적 배치나 밀도 분포가 변형될 경우 전체 형상의 일관성이 저해될 수 있다. EMD는 두 데이터 간의 전역적인 형상 불일치를 정량화하여 공간적 분포를 얼마나 유지하는지 평가하는데 적합하다. EMD는 식 (5)와 같이 확률 분포 P를 Q로 변환하는데 필요한 최적 이송 문제로 정의된다. Tij는 xi에서 yi로 이동하는 거리의 이송 계획을 의미하며 이송 계획 중에서 총 이송 비용을 최소화하는 값을 dEMD로 정의한다 (Wu et al., 2021).

| (5) |

본 연구에서는 원본 포인트 클라우드 전체와 경량화된 포인트 클라우드 간의 EMD를 계산하였으며 EMD는 값은 작을수록 경량화 후에도 선박 블록의 전체적인 형태와 규모, 위치를 잘 유지하고 있음을 의미한다.

또한 3차원 포인트 클라우드의 분포 균일성을 평가하기 위하여 최근접 이웃 거리(NND)를 활용하여 평가하였다. 이상적인 경량화 기법은 선박 블록의 외판과 같이 특징이 적은 넓은 영역에서는 점들을 최대한 균일하게 분포시켜 효율적으로 표현해야 한다. 이러한 분포의 균일성은 각 점으로부터 가장 가까운 이웃점까지의 거리가 얼마나 일정한지를 통해 파악할 수 있으며 점들이 고르게 분포할수록 점들의 최근접 이웃 거리는 서로 유사한 값을 가지게 되고 그 편차는 작아지기 때문이다. 이에 각 점 pi에 대해 최근접 이웃점까지의 거리 di를 계산하고 최근접 이웃 거리들의 평균(μNND)과 표준편차(σNND)를 산출하였으며 식 (6)에 각각 나타내었다 (Suriyababu et al., 2025).

| (6) |

μNND은 전체적인 점의 밀도를 반영하는 지표로 값이 작을수록 점들이 조밀하게 분포함을 의미한다. σNND는 점들 간격의 편차를 나타내며 값이 작을수록 공간상에 분포가 균일함을 의미하며 반대로 값이 클 경우 일부 영역에서 점이 밀집하거나 희소한 불균일한 분포임을 의미한다.

EMD와 NND는 특징 보존성 평가 지표와 상충 관계를 보이는 경우가 많으며 예를 들어 무작위 기법은 공간적 편향을 야기하지 않아 EMD 측면에서는 우수할 수 있지만 중요한 기하학적, 위상학적 특징을 파괴할 수 있다. 반면 TDA 기반 경량화 기법과 같이 특징 보존에 중점을 두는 기법은 특징점 주변에 점들이 집중되어 NND 측면의 균일성은 다소 떨어질 수 있다.

4.3 위상 구조 보존성 및 노이즈 강건성 평가

Betti 수는 경량화 데이터가 원본 데이터에 비해 위상학적 구조를 얼마나 잘 유지하는지 평가하기 위한 지표로 TDA 기반의 지속적 호몰로지를 사용하여 위상 구조를 비교하였다. 특히 0차, 1차 Betti 수를 중심으로 경량화 전후의 연결성 구조(H0)와 루프 구조(H1)를 분석하였다. 식 (7)과 같이 Betti 수(βk)는 k차 호몰로지 군(Hk)의 위상 구조의 수를 나타내며 즉 β1은 연결성분의 개수, β2는 루프의 개수에 해당한다 (Otter et al., 2017).

| (7) |

선박 블록은 격벽(bulkhead), 갑판(deck)으로 이루어진 내부 공간(void), 파이프나 케이블이 통과하는 관통부(hole) 등 다양한 위상학적 특징을 가지며 Betti 수를 통해 선박 블록의 핵심적인 위상 구조가 얼마나 잘 보존되었는지 평가할 수 있다. 만약 경량화 후에 원본 데이터보다 Betti 수가 감소하였다면 이는 일부 위상 구조가 손실된 경우라 할 수 있으며 증가한 경우에는 왜곡으로 인하여 인위적으로 생성되었을 가능성이 있다.

마지막으로 노이즈 강건성을 평가하기 위하여 Gaussian noise를 원본 데이터에 인위적으로 추가하였다. 조선소와 같이 실제 산업 현장에서 계측된 3차원 포인트 클라우드는 이상적인 환경에서 생성된 데이터와 달리 일정 수준의 노이즈를 포함하며 이는 산업적 적용 가능성을 가늠하는 중요한 지표이다. 3차원 유클리드 공간(R3)안에 있는 한 점 에 대하여 노이즈가 포함된 점 는 식 (8)과 같이 정의된다 (Zhou et al., 2024).

| (8) |

여기서 는 평균이 0이고 공분산 행렬이 σ2I3인 3차원 정규 분포에서 추출된 난수 벡터이며 σ는 노이즈 강도를 조절하는 표준편차를 I3은 3 × 3 단위행렬을 의미한다. 이후 노이즈 추가 후 경량화 데이터에 앞서 평가 지표를 다시 측정하여 노이즈 강건성을 비교하였으며 각 평가 지표에 대한 매개변수를 Table 1에 나타내었다.

5. 결 과

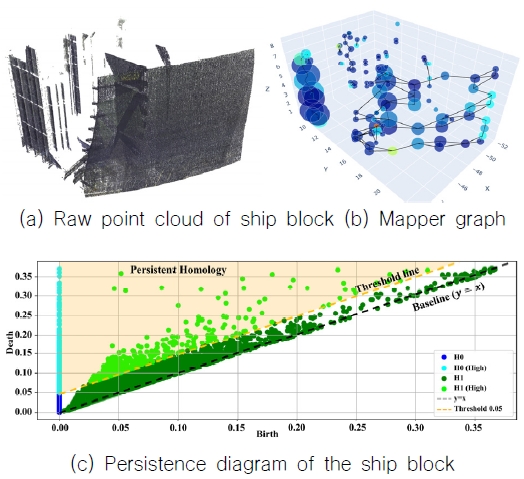

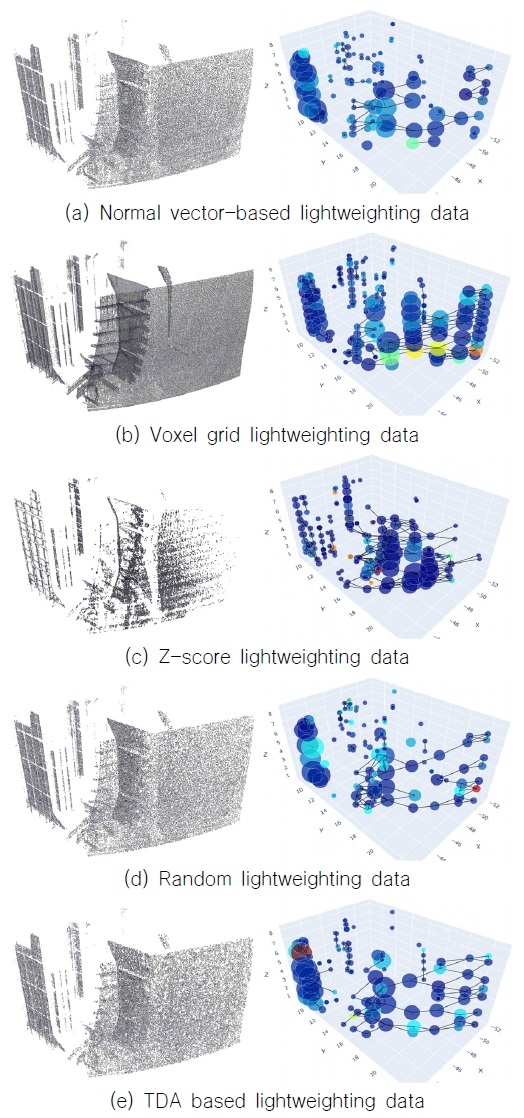

실제 계측된 선박 블록의 원본 포인트 클라우드와 Mapper 그래프를 Fig. 5(a), (b)에 각각 나타내었다. Mapper 그래프는 점들의 밀집 지역을 군집(node)과 군집 간의 연결 관계(edge)로 표현하고 저차원 그래프로 시각화함으로써 위상학적 구조를 정성적으로 확인할 수 있도록 한다 (Simi, 2025). 이와 같이 Fig. 6에는 각 경량화 기법에 대한 결과를 시각화하여 나타내었으며 Table 2에는 다각적 품질 평가 결과를 정량적으로 제시하였다.

Fig. 5(c)의 지속성 도표는 3장에서 제안된 방법을 원본 포인트 클라우드에 적용한 결과이며 상대적으로 생존시간이 긴 호몰로지를 구분하고 해당 호몰로지를 이루는 점들을 추출하여 경량화를 달성하였으며 그 결과를 Fig. 6(e)에 나타내었다.

먼저 LNV를 통한 표면 변화 보존성 평가 분석으로 LNV는 점 주변의 법선 벡터 변화를 측정하여 표면의 평탄화(smoothing) 또는 특징 보존 수준을 평가한다. 원본 데이터의 Mean_angle은 29.81°로 이는 선박 블록이 가진 고유의 기하학적 복잡성을 나타낸다. Voxel grid 기법은 Mean_angle과 Std_angle이 0.07°, 1.92°로 극단적인 평탄화 효과를 보였으며 이는 공간을 격자로 나누고 각 격자 내 점들을 하나의 점으로 평균화하는 과정에서 표면의 굴곡과 모서리 정보가 거의 소실되었음을 의미한다. 극단적인 곡률 변화를 나타내는 Max_angle 또한 154.91°로 크게 감소하여 날카로운 특징이 무뎌졌음을 확인할 수 있다. 반면 Z-score 기법은 Mean_angle이 52.96°로 원본 데이터보다 현저히 높게 나타났으며 이는 통계적 이상치를 기준으로 점을 제거하는 특성 때문으로 판단된다. 즉 평탄한 면에 위치한 규칙적인 점들이 제거되면서 남아있는 점들은 주로 모서리나 곡면과 같은 복잡한 영역에 집중되고 이로 인해 평균적인 변화가 오히려 과장되는 효과가 발생한 것으로 보인다. Max_angle은 174.32°로 원본 데이터의 174.80°와 거의 동일하게 유지되어 날카로운 특징 자체는 잘 보존된 것으로 판단된다. 본 연구에서 제안하는 TDA 기반 기법은 이 두 극단적인 품질 사이에서 균형 잡힌 성능을 보여주었다. Mean_angle은 20.81°로 Normal vector 기법이나 Random 기법보다 평탄화 효과가 적었으며 Max_angle은 171.54°로 Z-score 기법 다음으로 높아 원본 데이터의 날카로운 형상을 효과적으로 보존하였다. 또한 Std_angle은 25.80°로 원본의 특징을 비교적 잘 유지하였다. 결과적으로 LNV 평가에서는 TDA 기반 기법이 불필요한 평탄화를 최소화하였다.

다음으로 FPFH 기반 특징 분포 유사도 평가의 경우 개별 점 주변의 기하학적 패턴이 얼마나 잘 보존되었는지를 정보량(entropy)과 분포 유사도(JSD) 측면에서 다각적으로 분석하였다. Voxel grid 기법은 Avg_Entropy가 0.0066으로 원본 데이터의 1.5766에 비하면 거의 0에 가까웠으며 이는 LNV에서 관찰된 극단적인 평탄화 결과와 일관되게 기하학적 정보의 심각한 손실을 보여주었다. Normal vector 기법과 Random 기법 역시 각각 0.5068, 0.6555로 원본 데이터 대비 현저히 낮은 엔트로피를 보여 상당한 정보 손실이 발생한 것으로 판단된다. Z-score 기법은 Avg_Entropy가 1.6152로 가장 높고 Entropy_Diff는 0.6268로 가장 낮아 FPFH 히스토그램의 정보량을 가장 잘 보존하였으며 이는 특징점 위주의 경량화로 인한 결과로 판단된다. 한편 TDA 기반 기법은 Avg_JSD가 0.5427로 모든 기법 중 가장 낮게 나타났다. 이처럼 낮은 JSD 값은 경량화된 데이터의 FPFH 히스토그램 분포가 원본 데이터의 분포 패턴을 가장 충실하게 재현하고 있음을 의미한다. Random 기법의 경우 Avg_JSD가 0.5803으로 가장 높아 원본 데이터의 분포 패턴을 가장 많이 왜곡한 것으로 나타났다. 이처럼 정보량 보존 측면에서는 Z-score 기법이 우수하였으며 분포 유사도에서는 TDA 기반 기법의 우수성을 보여주었다.

EMD를 통한 전역적 형상 보존성 평가의 경우 두 포인트 클라우드 간의 전역적 형상 차이를 정량화하였으며 Random 기법이 0.1975로 가장 낮은 EMD를 기록하였다. 이는 무작위 경량화 기법 특성상 특정 영역에 대한 편향 없이 점을 추출하기 때문으로 판단된다. 반면 Voxel grid 기법은 2.3908과 Z-score 기법은 2.5184로 높은 EMD을 보였으며 이는 점들을 격자 중심으로 이동시키거나 제거하여 공간 분포를 심각하게 왜곡하였기 때문으로 판단된다. Normal vector 기법은 0.9251로 중간 수준의 왜곡을 나타내었으며 TDA 기반 기법은 0.6463이라는 비교적 낮은 EMD를 기록하여 Random 기법 다음으로 우수한 성능을 보였다.

NND를 통한 점 분포의 균일성 평가의 경우 평균(Mean_NND)과 표준편차(Std_NND)를 통해 점들의 밀도와 공간적 분포 균일성을 평가한다. Z-score 기법은 Mean_NND (0.0100)와 Std_ NND (0.0092)로 가장 낮아 가장 균일한 분포를 형성하였으며 Voxel grid 기법은 Mean_NND가 0.0357로 가장 높아 점 분포 밀도는 가장 낮았으나 Std_NND가 0.0117로 비교적 우수한 균일성을 보였다. 그러나 특징 보존을 목표하는 기법은 필연적으로 특징 영역에 점들이 집중되기 때문에 일정량의 불균일한 분포는 불가피하다. 즉 모서리나 곡면처럼 정보가 풍부한 영역에 점을 집중하고 평탄한 영역의 점을 줄이는 것은 다소 불균일한 분포를 야기할 수 있지만 오히려 특징 보존을 위한 결과로 해석될 수 있다. 이러한 관점에서 TDA 기반 기법의 Mean_NND는 0.0210으로 중간 수준의 밀도를 보였으며 Std_NND 역시 0.0158로 중간 정도의 균일성을 나타내었다. 이는 TDA가 위상학적 특징 보존에 중점을 두기 때문에 점 분포의 균일성은 다소 떨어지지만 기하학적으로 의미 있는 불균일성을 형성한 결과로 해석할 수 있다. 반면 Random 기법은 Std_NND가 0.0166으로 가장 높아 기하학적 의미 없이 무작위로 점들이 뭉치거나 흩어지는 비효율적인 불균일성을 보였다. 따라서 Z-score 기법이 가장 균일한 분포를 보였으나 TDA 기반 기법은 특징 보존의 필요성과 점 분포 균일성 사이의 균형을 이루고 있다고 평가할 수 있다.

Betti 수를 통한 위상 구조 보존성 평가에서는 연결 성분(H0)과 루프 구조(H1)의 개수를 측정하여 정량화하였다. 원본 데이터(H0:8,133, H1:1,030)와 비교하여 TDA 기법(H0:8,153, H1:1,173)은 위상 구조를 거의 동일하게 보존하였다.

반면 다른 모든 기법들은 구조적 왜곡을 유발하였으며 Voxel grid 기법(H0:10,661, H1:229)과 Random 기법(H0:9,837, H1:1,057)은 연결 성분을 파편화시켜 H0를 증가시켰으며 Normal vector 기법(H0:8,807, H1:905) 역시 상당한 파편화와 루프 구조의 손실을 보였다. 반면 Z-score 기법(H0:2,727, H1:367)은 선박 블록의 루프 구조를 메워버려 과도한 특징 손실을 유발하였다.

노이즈 강건성 평가의 경우 노이즈가 추가된 데이터에 대해 앞서 평가 지표에 대해 다시 한 번 평가하였으며 제안하는 TDA 기반 기법의 실용성을 보여주었다. 이는 노이즈 환경에서도 EMD(0.6000)와 Betti 수(H0:8,775, H1:1,140)가 매우 안정적으로 유지되어 뛰어난 강건성을 보여주었다. 반면 Z-score 기법은 Avg_Entropy가 1.6152에서 0.3764로 급감하여 노이즈로 인한 기하학적 정보의 심각한 손상을 보여주었으며 Normal vector 기법 역시 Mean_angle 18.07°에서 9.81°로 크게 감소하여 노이즈의 영향을 많이 받은 것을 확인하였다. Voxel grid 기법과 Random 기법은 연결 성분의 파편화가 더욱 심화되는 문제를 보였으며 Voxel grid의 Betti 수 H0은 10,661에서 11,459개로 증가하고 Random 기법도 9,837에서 10,626개로 크게 증가하여 노이즈가 위상학적 구조의 단절을 악화시킨 것으로 판단된다.

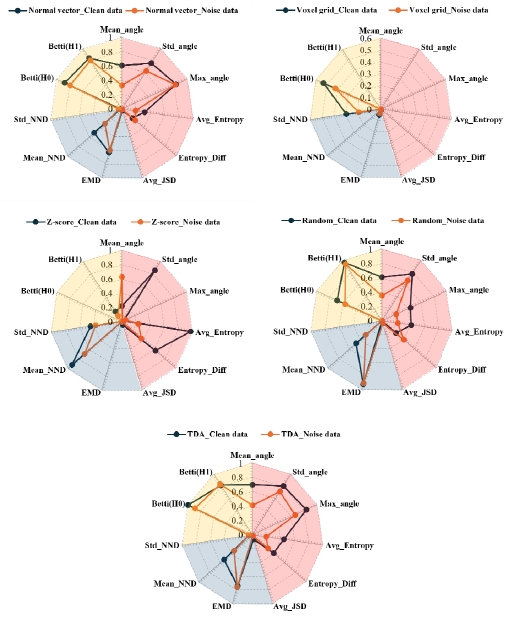

Fig. 7은 Table 2의 복잡한 정량적 평가 결과를 정규화하여 각 경량화 기법의 다각적인 성능을 방사형 차트로 시각화하였다. 이는 각 기법의 성능을 직관적으로 이해하고 비교하기 위함이며 다각형의 면적이 넓고 형태가 균형 잡혀 있을수록 해당 기법이 세 가지 측면에서 원본 데이터의 특징을 잘 보존하고 있음을 의미한다. 또한 Clean 데이터와 Noise 데이터에 대한 두 다각형의 형태 및 크기 유사성은 해당 기법의 노이즈 강건성을 명확하게 보여준다. 이처럼 본 연구에서 제안하는 TDA 기반 기법은 대부분의 평가 항목에서 균형 잡힌 성능을 보여주었으며 선박 블록의 지역적인 형상, 크기, 기하학적 패턴, 위상학적 특성 등 원본 데이터의 필요한 정보를 균형 있게 유지한 것으로 판단된다.

6. 결 론

본 연구에서는 위상 데이터 분석(TDA) 기반 3차원 포인트 클라우드의 경량화 기법을 실제 조선 산업의 선박 블록에 적용하였다. 제안된 기법의 핵심은 지속적 호몰로지를 적용하여 원본 데이터가 가진 연결성분(H0)이나 루프(H1)와 같은 위상 구조를 정의하는 특징점을 식별하고 보존함으로써 데이터의 양은 줄이면서도 객체의 본질적인 형상 정보는 최대한 유지하는데 있다. 제안된 TDA 기반 경량화 기법의 실질적인 성능을 검증하기 위하여 실제 선박 블록 데이터에 적용하고 그 결과를 기존의 대표적인 경량화 기법들과 정량적으로 비교 분석하였다. 종합적으로 정량적 평가 결과들은 제안된 TDA 기반 경량화 기법이 지역적 특징 보존성, 전역적 분포 균일성, 노이즈 강건성이라는 핵심적인 측면에서 기존 기법들보다 우수하거나 균형 잡힌 성능을 제공하고 있음을 명확히 보여주었다. 본 연구에서 제안하고 검증한 TDA 기반 경량화 기법은 조선 산업 현장에서 수집되는 대용량 데이터의 취급 용이성을 크게 향상시키므로 데이터 저장 공간의 절약과 처리 시간 단축과 같은 단순한 비용 절감을 넘어 조선 생산 관리 전반의 효율성을 증대시킬 것이다. 즉 데이터 처리의 장벽이 낮아짐에 따라 3차원 정보를 보다 적극적이고 다양한 방식으로 활용할 수 있을 것으로 기대된다. 특히 TDA를 통해 추출된 위상 특징들은 향후 딥러닝 모델 학습을 위한 고품질 학습 데이터셋 구축에 매우 효과적으로 활용될 수 있으며 향후 연구에는 딥러닝 기반 3차원 포인트 클라우드 경량화 전략에 적용하여 위상 특징을 결합하는 연구를 지속할 계획이다.

Acknowledgments

이 논문은 2025년도 정부(교육부)의 재원으로 한국연구재단 국립대학육성사업의 지원을 받아 수행된 연구입니다.

References

- Achlioptas, P., Diamanti, O., Mitliagkas, I. and Guibas, L., 2018. Learning representations and generative models for 3d point clouds. Proceedings of the International Conference on Machine Learning (PMLR), Stockholm, Sweden, 10-15 July, pp.80-89.

-

Bauer, U., 2021. Ripser: efficient computation of Vietoris–Rips persistence barcodes. Journal of Applied and Computational Topology, 5(3), pp.391-423.

[https://doi.org/10.1007/s41468-021-00071-5]

-

Guo, H., Du, L. and Li, G., 2024. An investigation of geometric feature recognition in 3D ship data. International Journal of Naval Architecture and Ocean Engineering, 16, Article 100597.

[https://doi.org/10.1016/j.ijnaoe.2024.100597]

-

Honti, R., Erdélyi, J. and Kopáčik, A., 2022. Semi-automated segmentation of geometric shapes from point clouds. Remote Sensing, 14(18), Article 4591.

[https://doi.org/10.3390/rs14184591]

-

Hu, C., Ru, Y., Fang, S., Zhou, H., Xue, J., Zhang, Y., Li, J., Xu, G. and Fan, G., 2023. A tree point cloud simplification method based on FPFH information entropy. Forests, 14(7), Article 1507.

[https://doi.org/10.3390/f14071507]

-

Jang, M.S., Ruy, W.S., Park, C.K. and Kim, D.E., 2018. A study on the prediction system of block matching rework time. Journal of the Society of Naval Architects of Korea, 55(1), pp.66-74.

[https://doi.org/10.3744/SNAK.2018.55.1.66]

-

Jung, K.S., Kim, J.S., Park, B.Y. and Lee, D.K., 2025. Post-processing methods and applications for ship block 3D scanning data based on open-source point cloud algorithms. Journal of the Society of Naval Architects of Korea, 62(1), pp.57-66.

[https://doi.org/10.3744/SNAK.2025.62.1.57]

-

Kong, G. and Fan, H., 2024. PH-shape: an adaptive persistent homology-based approach for building outline extraction from ALS point cloud data. Geo-spatial Information Science, 27(4), pp.1107-1117.

[https://doi.org/10.1080/10095020.2023.2280569]

-

Lee, D.K. and Park, B.Y., 2023. A case study for 3D scanning-based quantitative quality control during key stages of composite small craft production. International Journal of Naval Architecture and Ocean Engineering, 15, Article 100534.

[https://doi.org/10.1016/j.ijnaoe.2023.100534]

-

Lee, D.K., Ji, S.H. and Park, B.Y., 2021. Object detection and post-processing of LNGC CCS scaffolding system using 3D point cloud based on deep learning. Journal of the Society of Naval Architects of Korea, 58(5), pp.303-313.

[https://doi.org/10.3744/SNAK.2021.58.5.303]

-

Otter, N., Porter, M.A., Tillmann, U., Grindrod, P. and Harrington, H.A., 2017. A roadmap for the computation of persistent homology. EPJ Data Science, 6, Article 17.

[https://doi.org/10.1140/epjds/s13688-017-0109-5]

-

Rusu, R.B., Blodow, N. and Beetz, M., 2009. Fast point feature histograms (FPFH) for 3D registration. Proceedings of the 2009 IEEE International Conference on Robotics and Automation (ICRA), Kobe, Japan, 12-17 May, pp.38-45.

[https://doi.org/10.1109/ROBOT.2009.5152473]

- Simi, L., 2025. A scalable approach for mapper via efficient spatial search. Transactions on Machine Learning Research.

-

Song, S.H., Lee, G.H., Han, K.M. and Jang, H.S., 2022. Application of point cloud based hull structure deformation detection algorithm. Journal of the Society of Naval Architects of Korea, 59(4), pp.235-242.

[https://doi.org/10.3744/SNAK.2022.59.4.235]

-

Sun, J., Hiekata, K., Yamato, H., Nakagaki, N. and Sugawara, A., 2014. Efficient point cloud data processing in shipbuilding: reformative component extraction method and registration method. Journal of Computational Design and Engineering, 1(3), pp.202-212.

[https://doi.org/10.7315/JCDE.2014.020]

-

Suriyababu, V.K., Vuik, C. and Möller, M., 2025. Resampling point clouds using series of local triangulations. Journal of Imaging, 11(2), Article 49.

[https://doi.org/10.3390/jimaging11020049]

-

Wang, J., Huo, S., Liu, Y., Li, R. and Liu, Z., 2020. Research of fast point cloud registration method in construction error analysis of hull blocks. International Journal of Naval Architecture and Ocean Engineering, 12, pp.605-616.

[https://doi.org/10.1016/j.ijnaoe.2020.06.006]

- Wu, T., Pan, L., Zhang, J., Wang, T., Liu, Z. and Lin, D., 2021. Density-aware chamfer distance as a comprehensive metric for point cloud completion. Proceedings of the 35th International Conference on Neural Information Processing Systems (NeurIPS), Virtual Event, 6-14 December, pp.24103-24114.

-

Zhou, W., Yang, Q., Chen, W., Jiang, Q., Zhai, G. and Lin, W., 2024. Blind quality assessment of dense 3D point clouds with structure guided resampling. ACM Transactions on Multimedia Computing, Communications, and Applications, 20(8), Article 247.

[https://doi.org/10.1145/3664199]